评估 是一种量化衡量 LLM 应用性能的方法。LLM 的行为可能难以预测,即使是提示词、模型或输入的微小变化,也可能显著影响结果。评估提供了一种结构化的方式来识别故障、比较版本,并构建更可靠的 AI 应用。 在 LangSmith 中运行评估需要三个关键组件: 本快速入门将引导您运行一个入门评估,使用 LangSmith SDK 或 UI 来检查 LLM 响应的正确性。Documentation Index

Fetch the complete documentation index at: https://langchain-zh.cn/llms.txt

Use this file to discover all available pages before exploring further.

先决条件

开始之前,请确保您拥有:- LangSmith 账户:在 smith.langchain.com 注册或登录。

- LangSmith API 密钥:遵循 创建 API 密钥 指南。

- OpenAI API 密钥:从 OpenAI 控制台 生成。

- UI

- SDK

1. 设置工作区密钥

在 LangSmith UI 中,请确保您的 API 密钥已设置为 工作区机密。- 前往 设置,然后转到 机密 选项卡。

- 选择 添加机密,并输入密钥环境变量(例如,

OPENAI_API_KEY或ANTHROPIC_API_KEY)以及您的 API 密钥作为 值。 - 选择 保存机密。

在 LangSmith UI 中添加工作区机密时,请确保机密密钥与模型提供商预期的环境变量名称匹配。

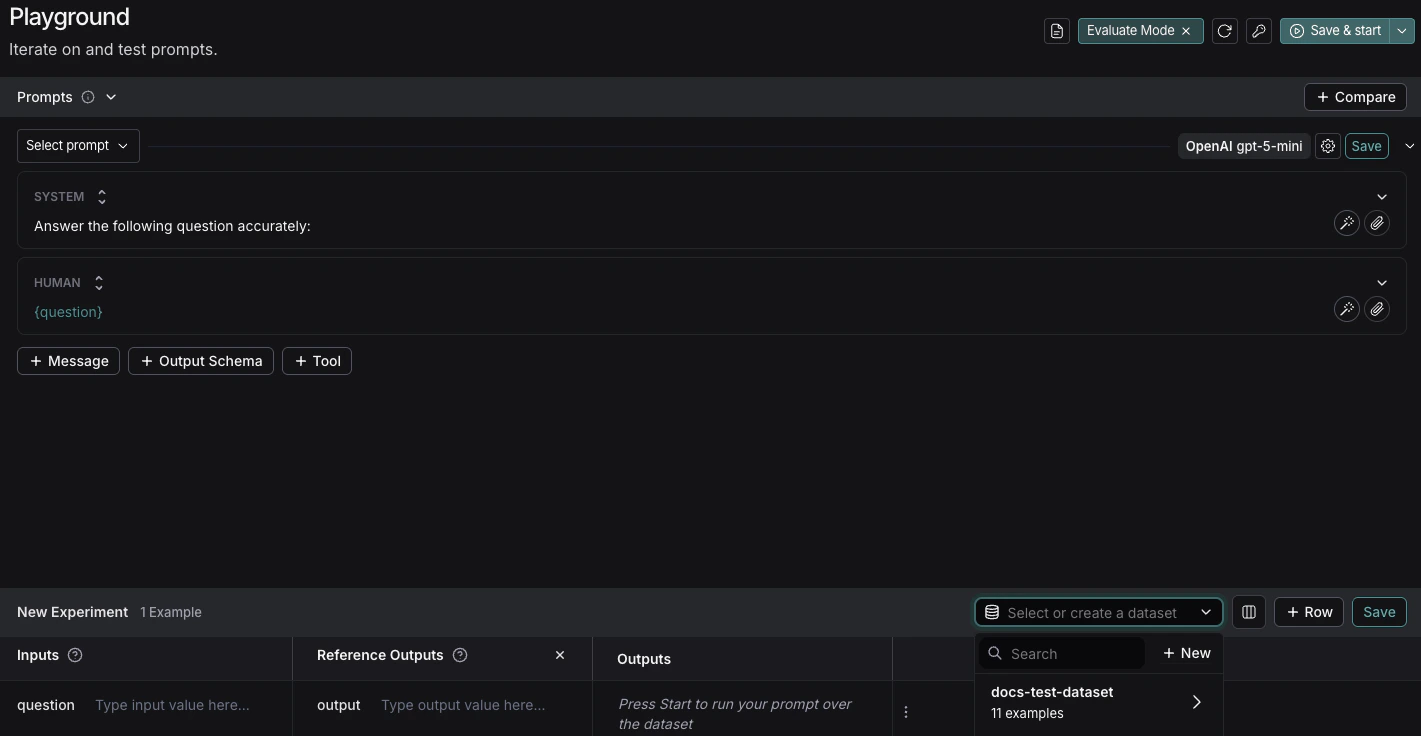

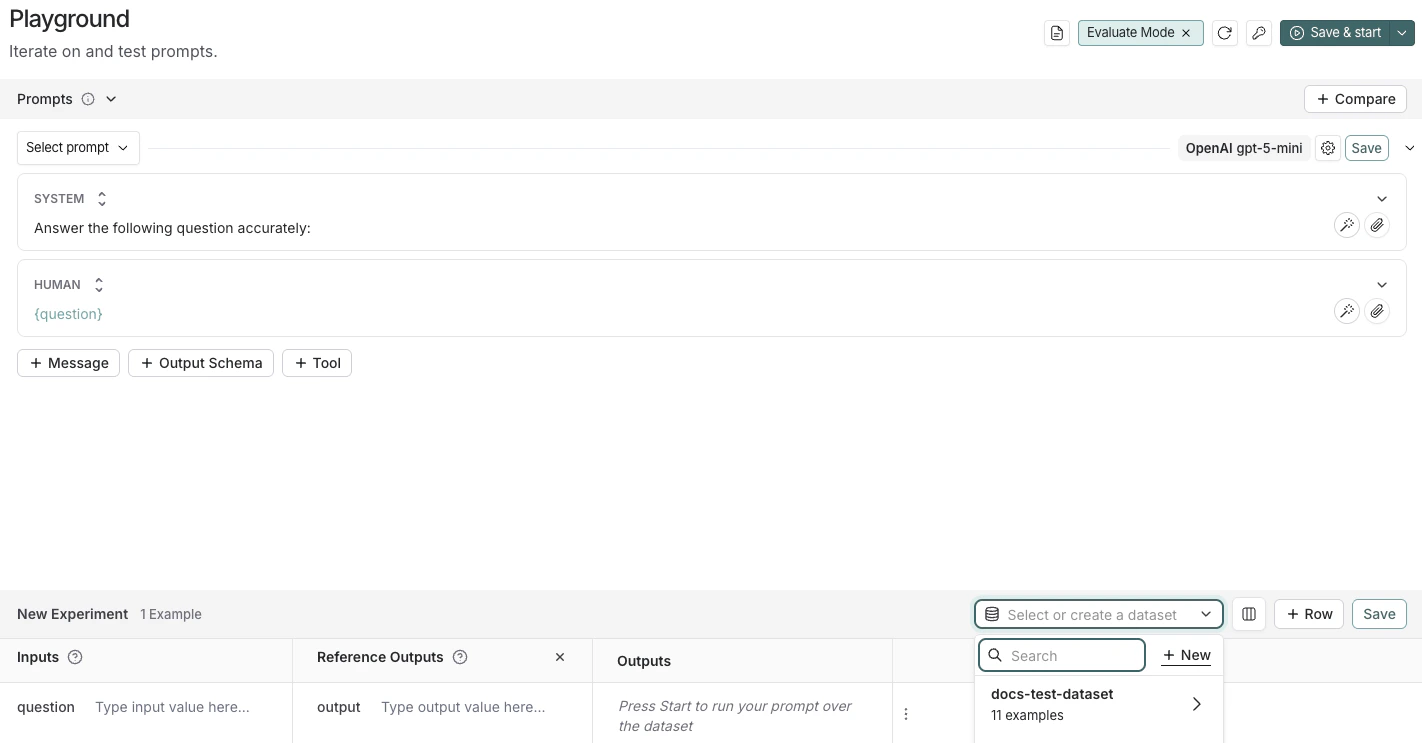

2. 创建提示词

Playground 使得可以针对不同的提示词、新模型或测试不同的模型配置运行评估。- 在 LangSmith UI 中,点击侧边栏的 Playground。

-

在 Prompts 面板下,将 system 提示词修改为:

保持 Human 消息不变:

{question}。

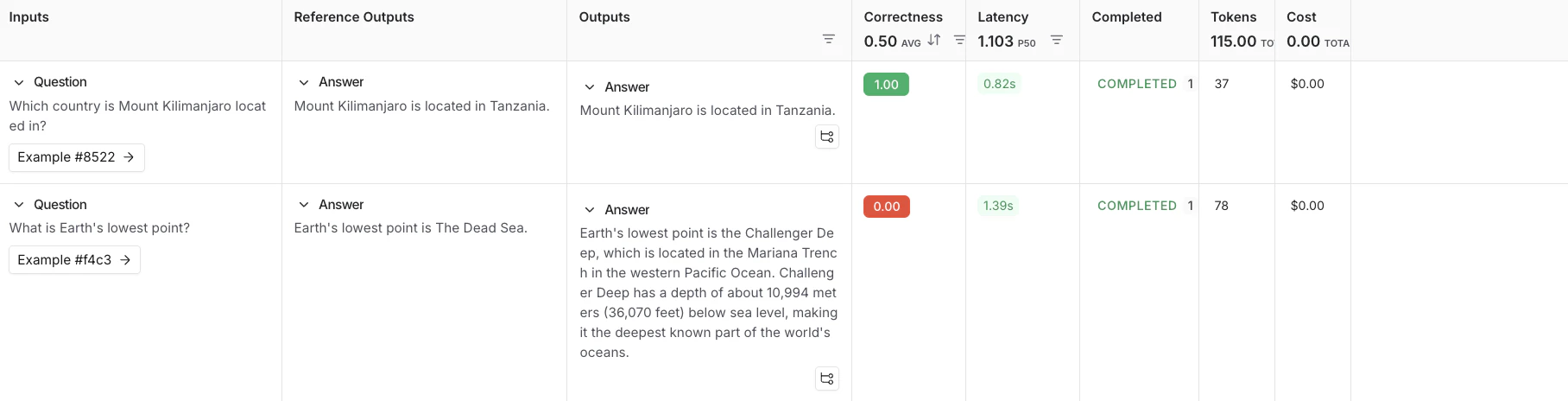

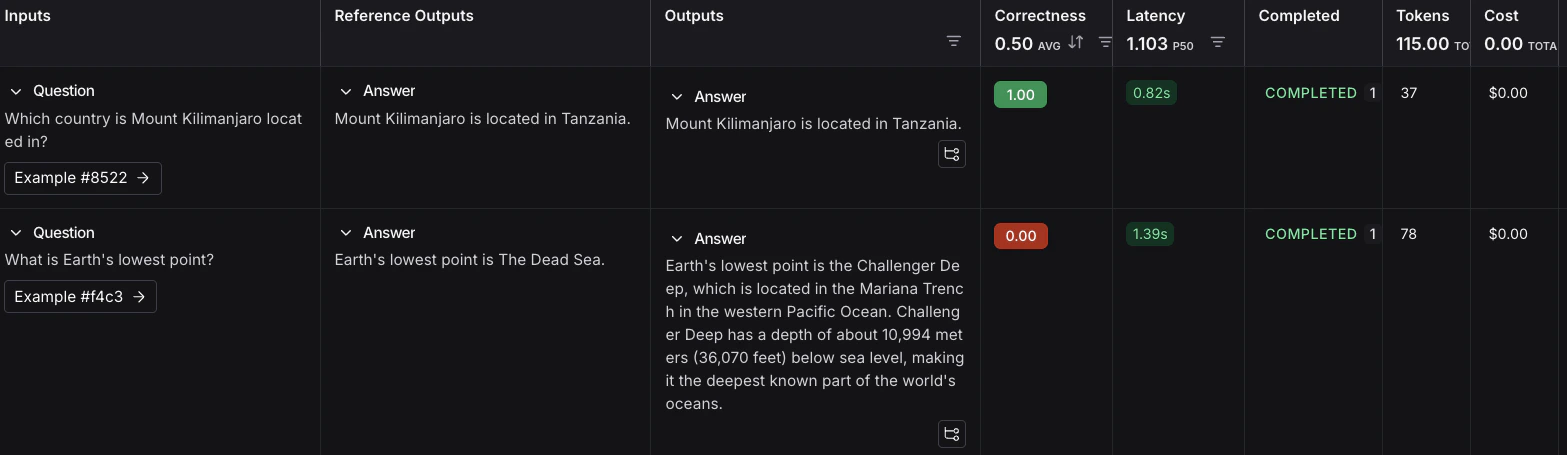

3. 创建数据集

- 点击 Set up Evaluation,这将在页面底部打开一个 New Experiment 表格。

-

在 Select or create a new dataset 下拉菜单中,点击 + New 按钮创建一个新数据集。

-

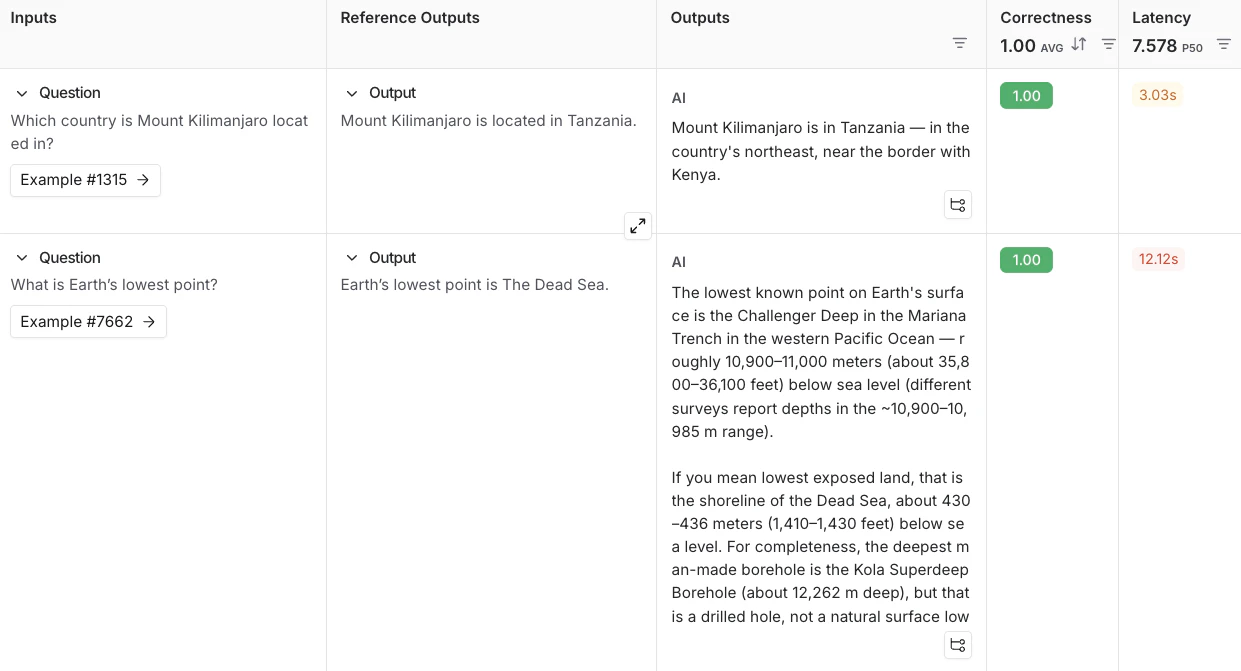

将以下示例添加到数据集中:

输入 参考输出 question: 乞力马扎罗山位于哪个国家? output: 乞力马扎罗山位于坦桑尼亚。 question: 地球的最低点是什么? output: 地球的最低点是死海。 - 点击 Save 并输入名称以保存您新创建的数据集。

4. 添加评估器

- 点击 + Evaluator,从 Prebuilt Evaluator 选项中选择 Correctness。

- 在 Correctness 面板中,点击 Save。

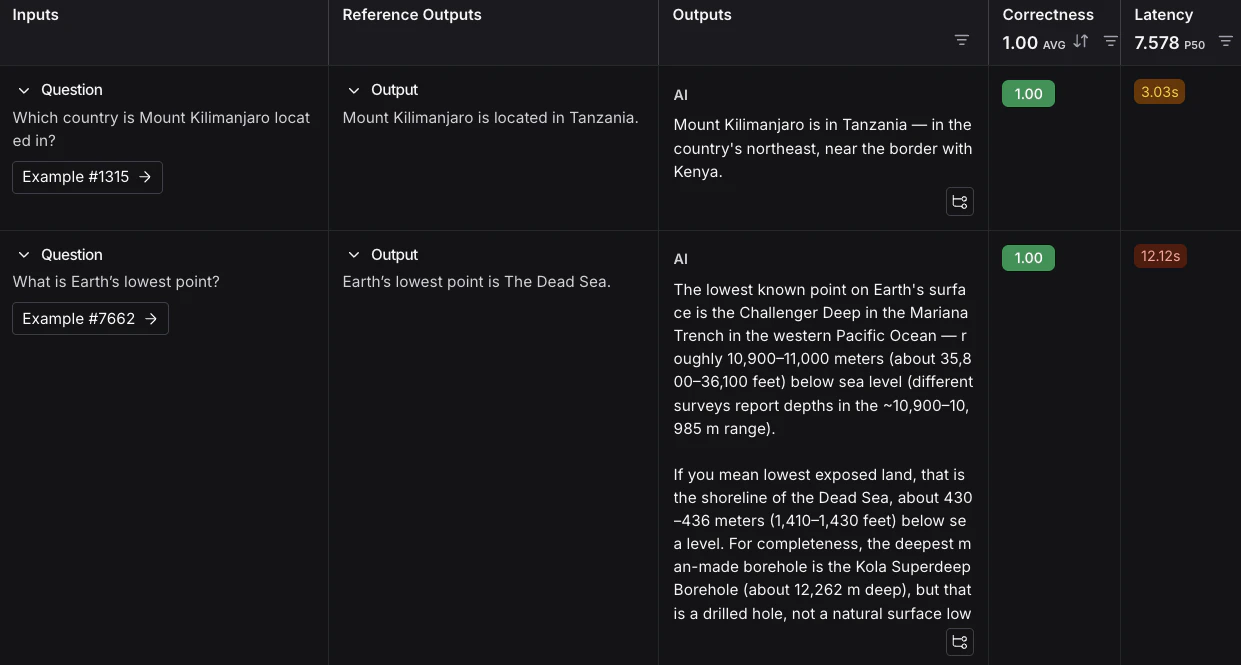

5. 运行评估

-

选择右上角的 Start 来运行您的评估。这将在 New Experiment 表格中创建一个带有预览的 实验。您可以点击实验名称查看完整视图。

后续步骤

- 有关评估的更多详细信息,请参阅 评估文档。

- 学习如何在 UI 中 创建和管理数据集。

- 学习如何 从 Playground 运行评估。

Connect these docs to Claude, VSCode, and more via MCP for real-time answers.