本页介绍了在 LangSmith 中使用实验的一些基本任务:Documentation Index

Fetch the complete documentation index at: https://langchain-zh.cn/llms.txt

Use this file to discover all available pages before exploring further.

- 分析单个实验:查看和解释实验结果、自定义列、筛选数据以及比较运行。

- 在实验标签页视图中设置基线:为您希望超越的数据集设置基线。

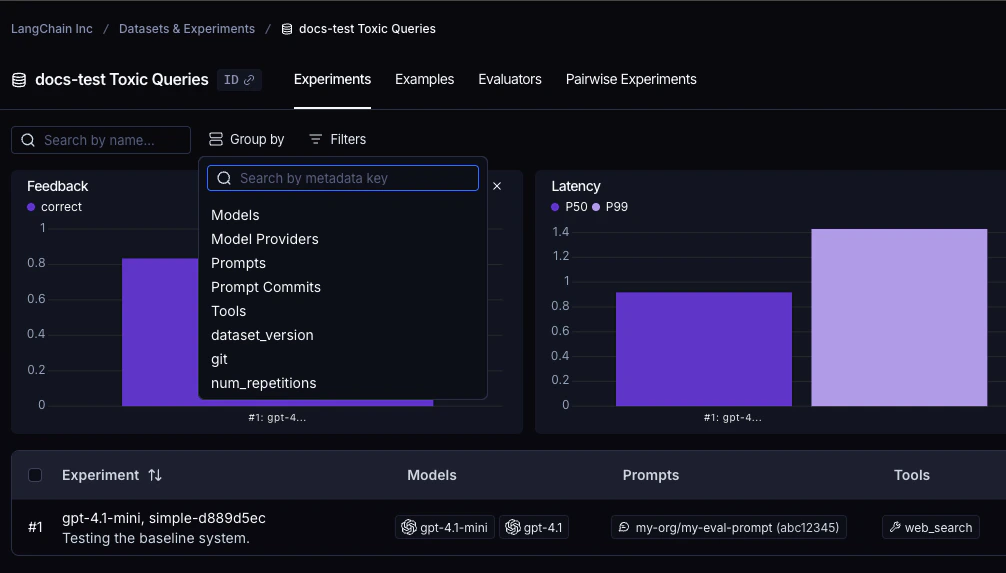

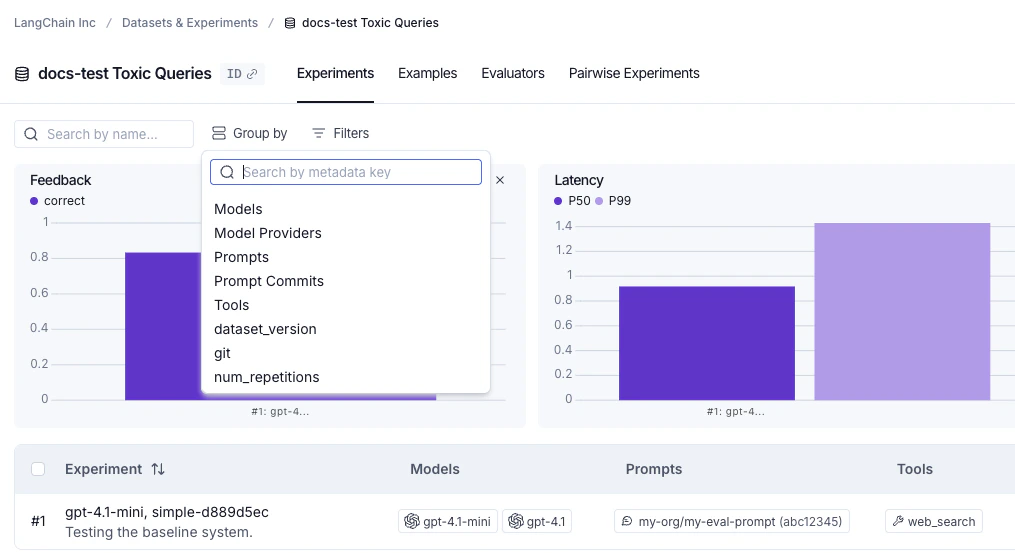

- 在实验标签页视图中按模型、提示词和工具进行筛选和分组:使用模型、提示词和工具列在实验标签页视图中筛选和分组实验。

- 将实验结果下载为 CSV:导出实验数据以供外部分析和共享。

- 重命名实验:在 Playground 和实验视图中更新实验名称。

分析单个实验

运行实验后,您可以使用 LangSmith 的实验视图来分析结果并获取关于实验性能的洞察。打开实验视图

要打开实验视图,- 从数据集与实验页面选择相关的数据集,这将打开实验标签页视图。

- 点击您要查看的实验所在的行。

查看实验结果

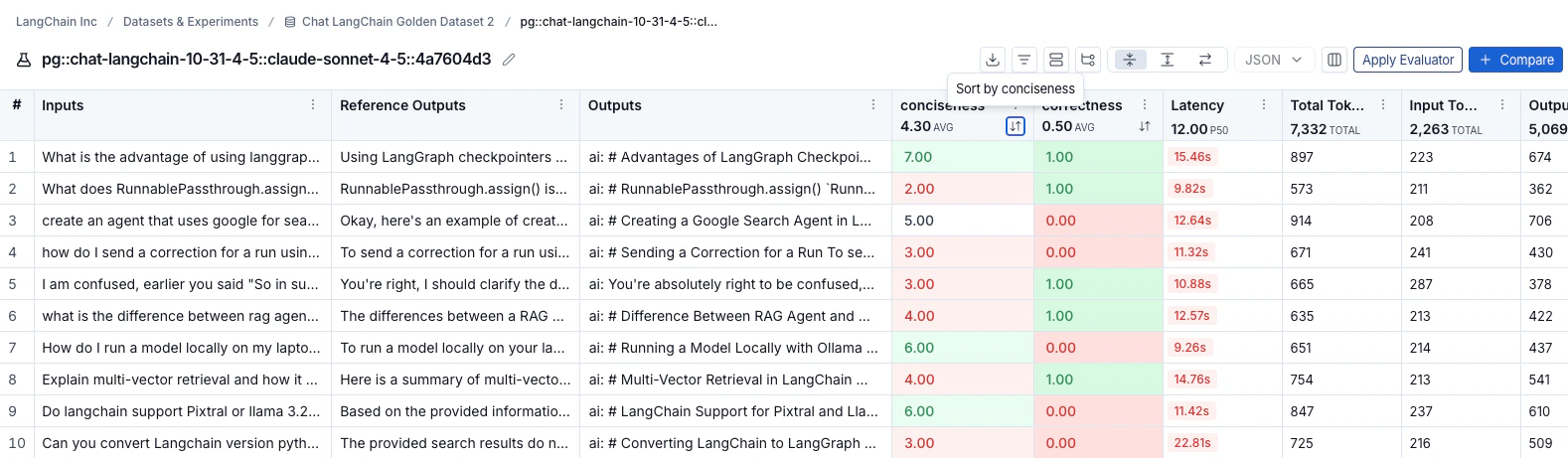

自定义列

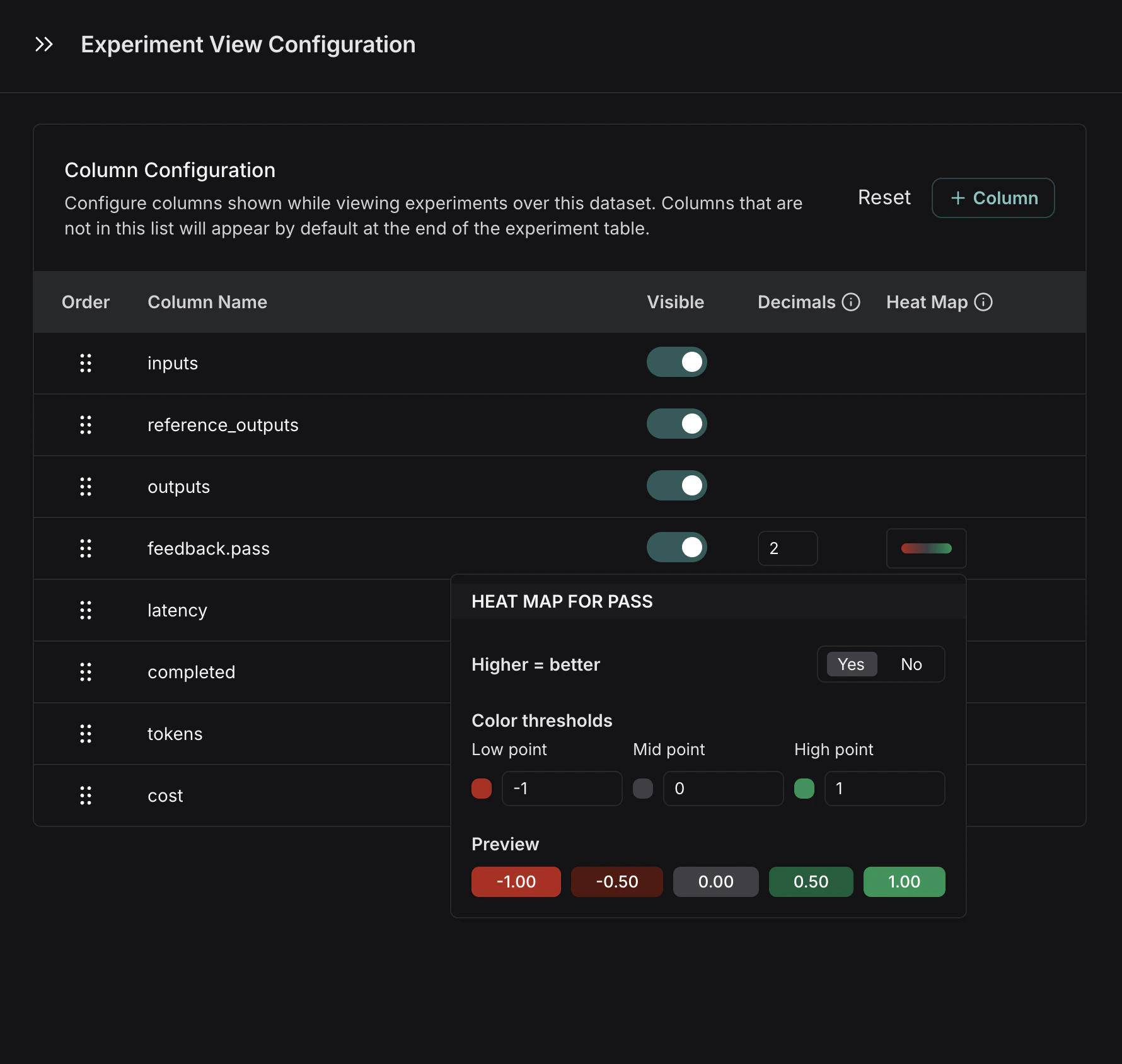

默认情况下,实验视图显示数据集中每个示例的输入、输出和参考输出,以及来自评估的反馈分数和实验指标,如成本、令牌数、延迟和状态。 您可以点击视图右上角的列图标来自定义列,以便更轻松地解释实验结果:- 将输入、输出和参考输出中的字段拆分到各自的列中。如果您有较长的输入/输出/参考输出,并希望突出重要字段,这尤其有用。

- 隐藏和重新排序列以创建用于分析的聚焦视图。

- 控制反馈分数的小数精度。默认情况下,LangSmith 以 2 位小数精度显示数值反馈分数,但您可以将此设置自定义为最多 6 位小数。

- 为实验中的数值反馈分数设置热图阈值为高、中、低,这会影响分数芯片显示为红色或绿色的阈值:

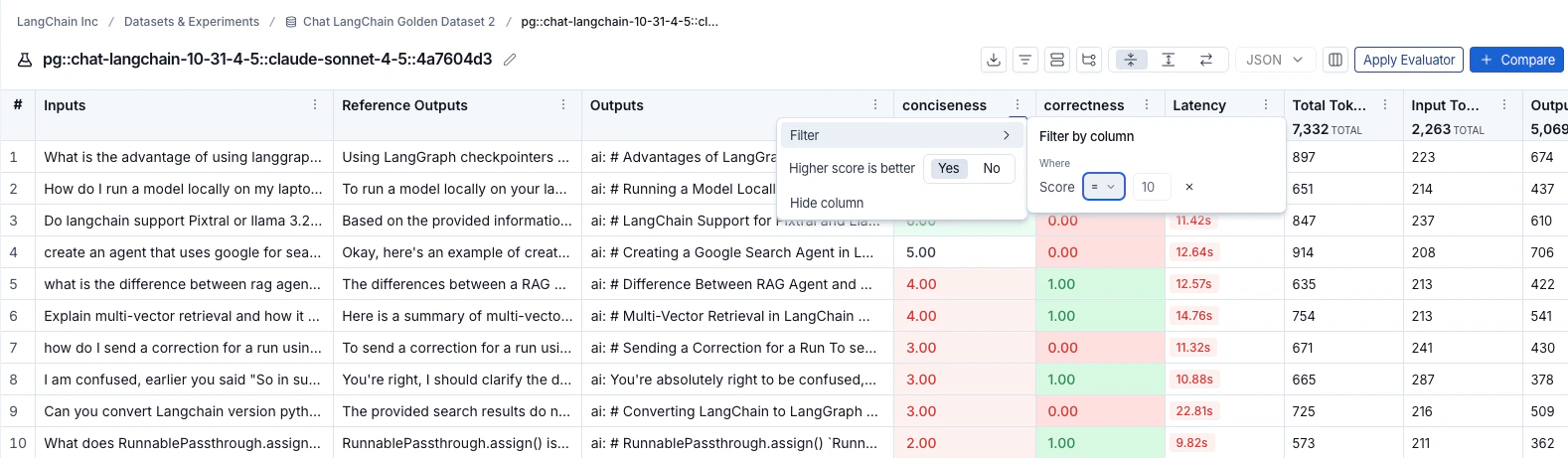

排序和筛选

要按反馈分数对行进行排序,请点击列标题中的排序图标。

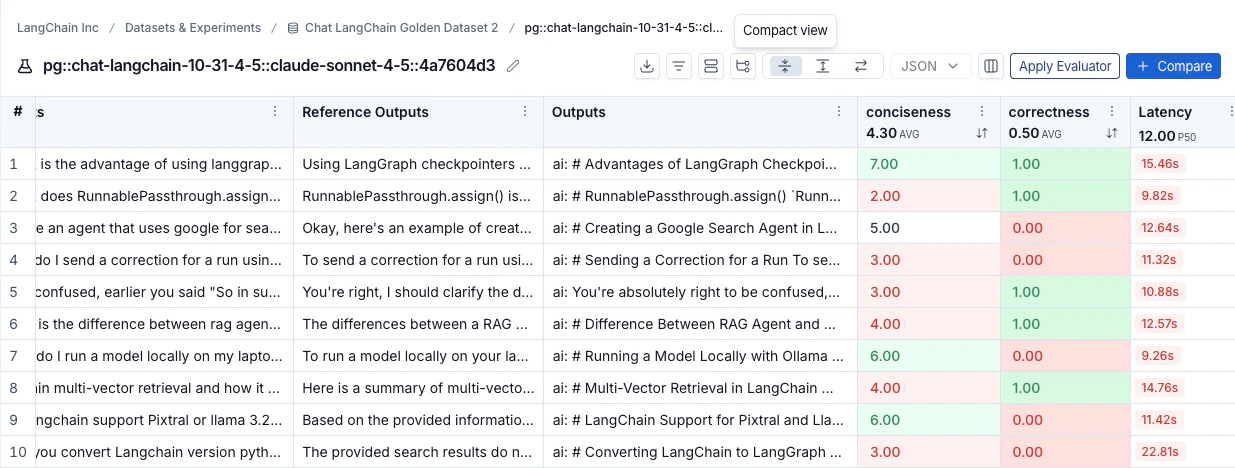

表格视图

在实验视图右上角选择三个表格视图图标之一:- 紧凑:将每次运行显示为单行,以便快速比较分数。

- 完整:显示每次运行的完整输出。

- 差异:显示每次运行的参考输出与输出之间的文本差异。

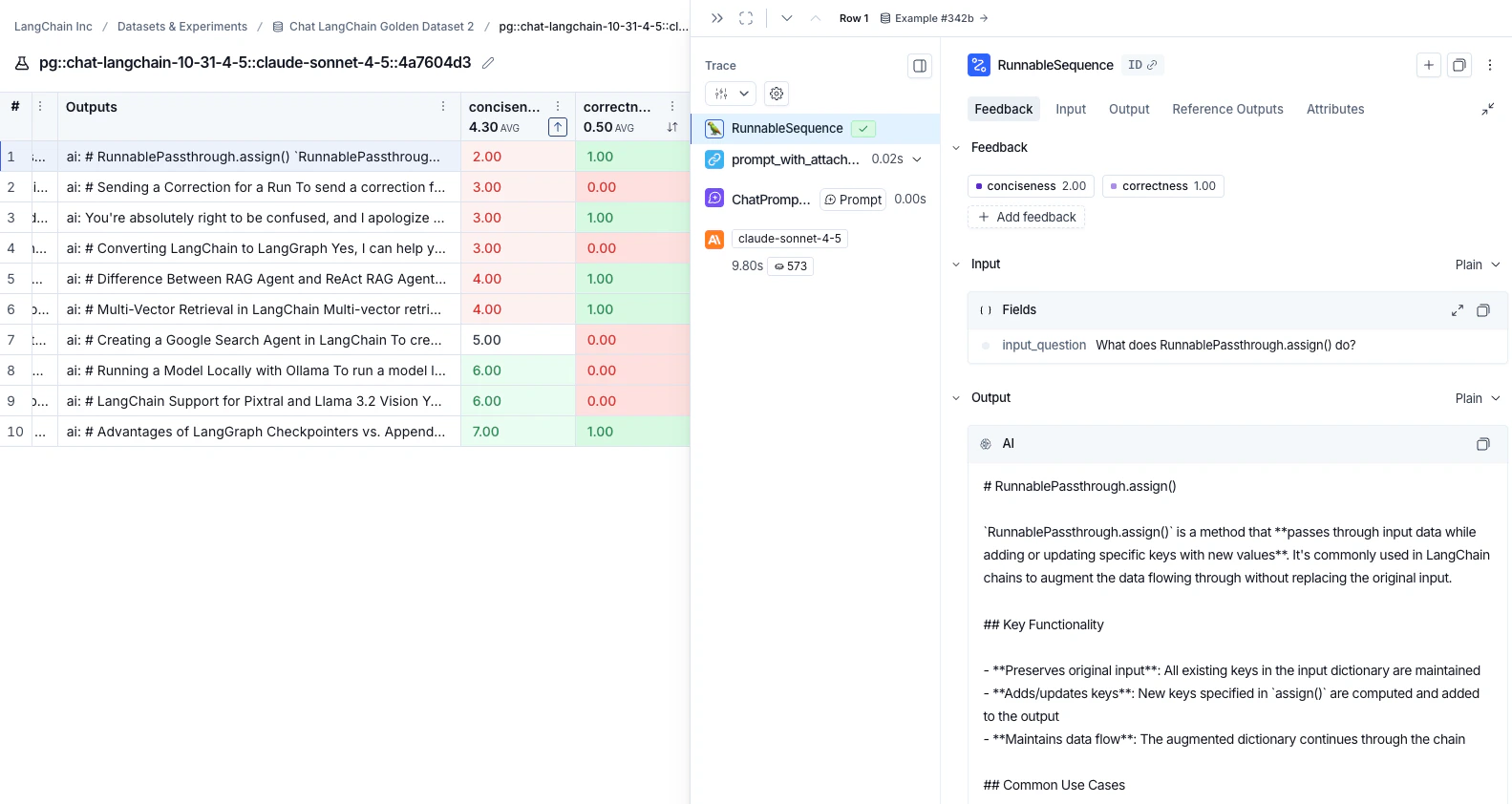

查看追踪

点击实验视图中的任意行以打开详细信息面板,该面板显示该次运行的追踪以及反馈、输入、输出和属性。

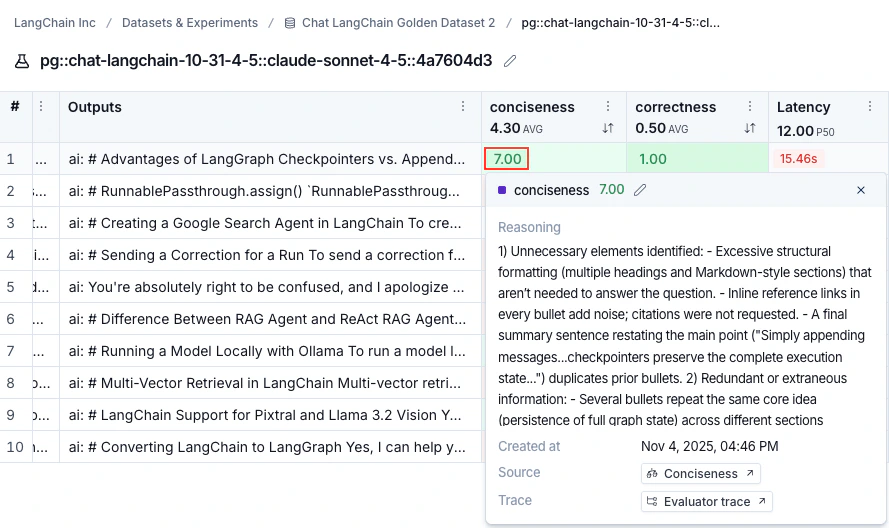

查看评估器运行

将鼠标悬停在评估器分数上,可以查看该评估器运行的更多详细信息。对于LLM-as-a-judge 评估器,点击来源链接以查看使用的提示词,或点击评估器追踪以在新浏览器标签页中打开追踪。对于具有重复运行的实验,点击聚合平均分数以查看所有单独运行的链接。

按元数据分组结果

您可以向示例添加元数据以进行分类和组织。例如,如果您正在评估问答数据集的事实准确性,元数据可能包括每个问题所属的主题领域。元数据可以通过UI或SDK添加。 要按元数据分析结果,请使用实验视图右上角的分组依据图标并选择所需的元数据键。这将显示每个元数据组的平均反馈分数、延迟、总令牌数和成本。您只能在 2025 年 2 月 20 日之后创建的实验上按示例元数据进行分组。此日期之前的任何实验仍然可以按元数据分组,但仅限于实验追踪本身包含元数据的情况。

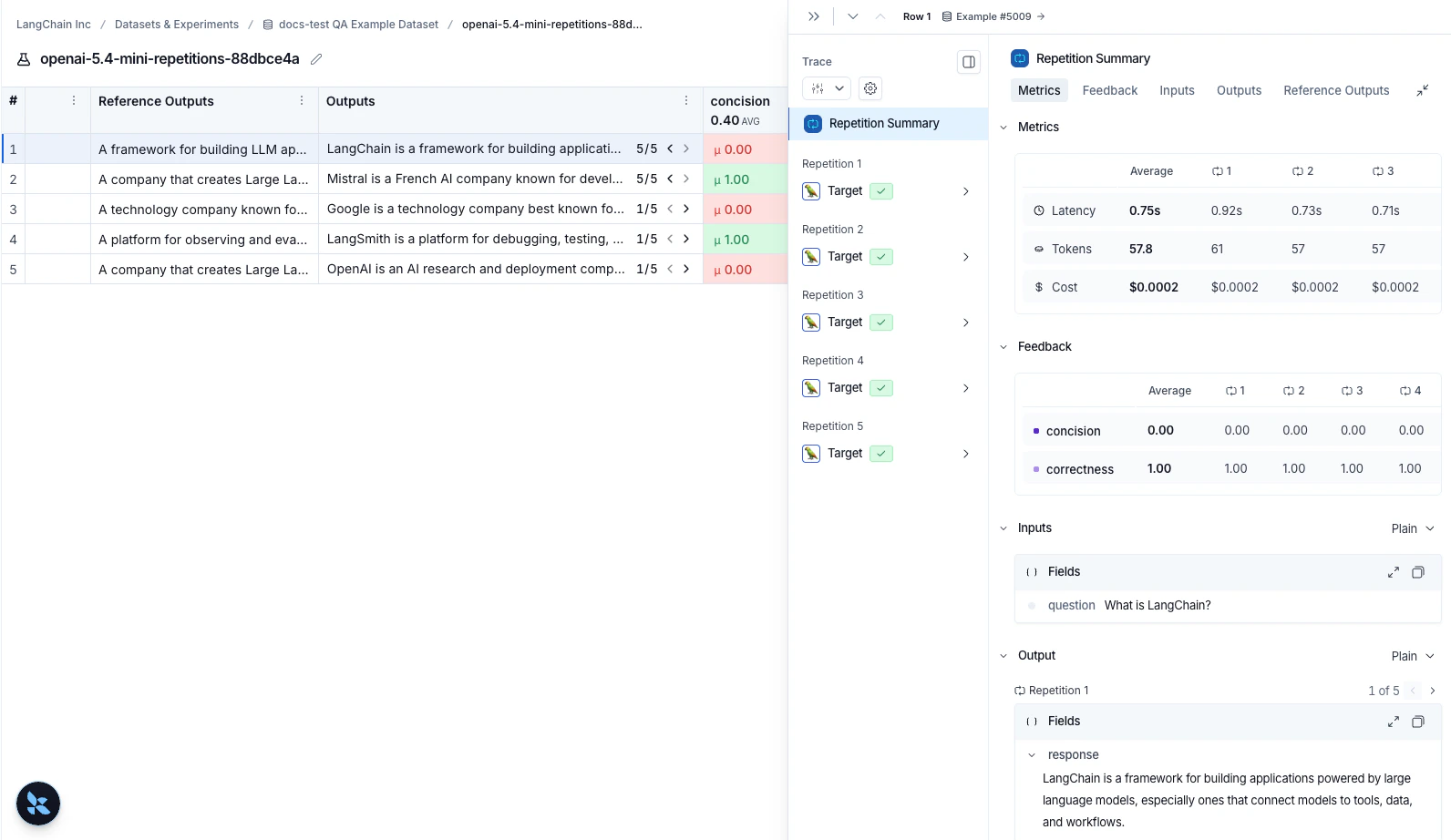

重复运行

如果您使用重复运行运行了实验,请点击任意行以打开详细信息面板。重复运行摘要显示指标表格、所有反馈分数,并允许您切换输出或查看具有其追踪的各个重复运行。

与另一个实验比较

在实验视图的右上角,您可以选择另一个实验进行比较。这将打开比较视图,您可以看到两个实验的对比情况。要了解更多关于比较视图的信息,请参阅如何比较实验结果。在实验标签页视图中设置基线

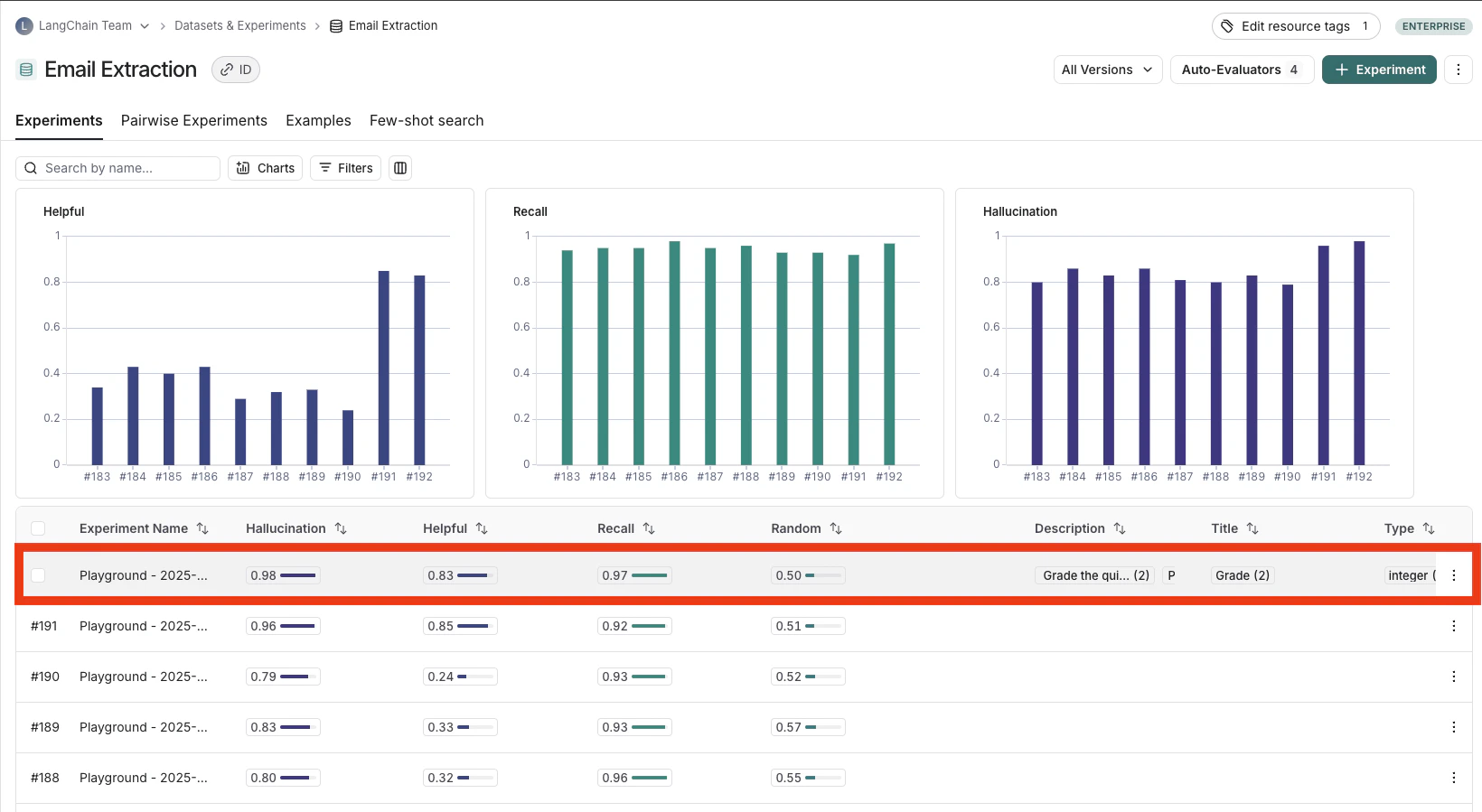

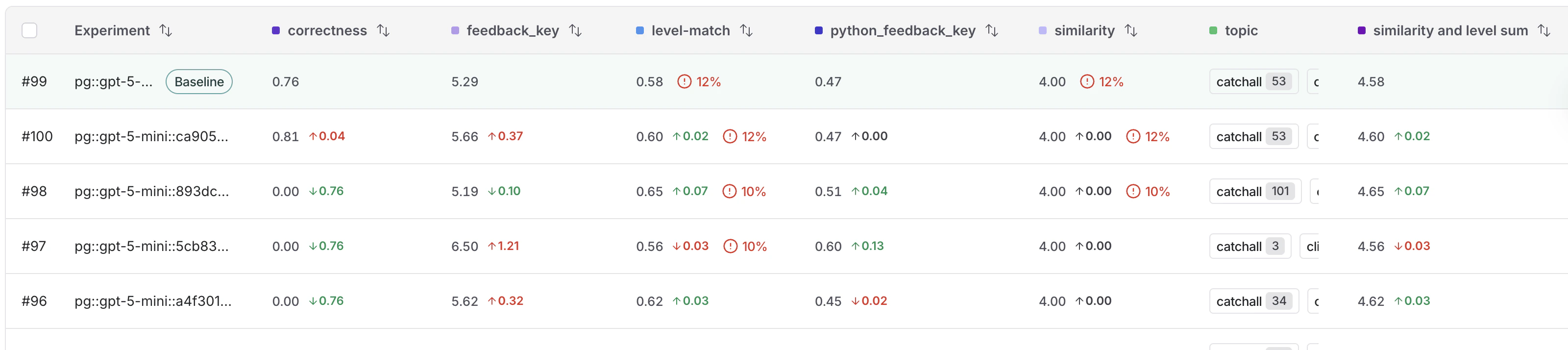

虽然您可能运行数十次测试,但通常有一个特定的基准您希望超越。设置_基线_可以将您的结果锚定在这个参考点上,从而在拥挤的实验列表中识别改进或回归。 通过指定基线,您可以:- 突出显示参考:明确标记您的最佳运行,以便在迭代时它始终显示在实验标签页视图的顶部。

- 查看即时差异:自动查看所有实验的性能差异,这意味着您不一定需要手动进行并排选择。

- 加速评估:快速确定新迭代是否达到或超过您当前的性能标准。

- 在 LangSmith UI 中,导航至左侧菜单中的数据集与实验选项。

- 从表格中选择您要处理的数据集。

- 在实验标签页视图中,将鼠标悬停在实验行上以在行右侧显示设为基线按钮。点击以选择您的基线实验。

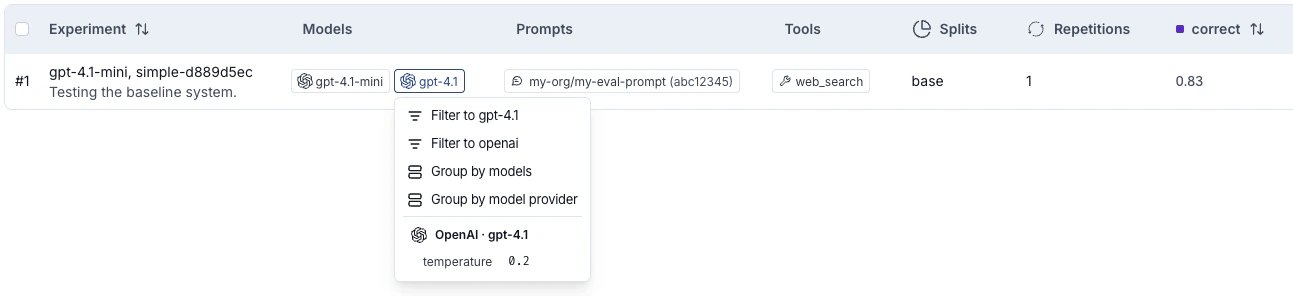

在实验标签页视图中按模型、提示词和工具进行筛选和分组

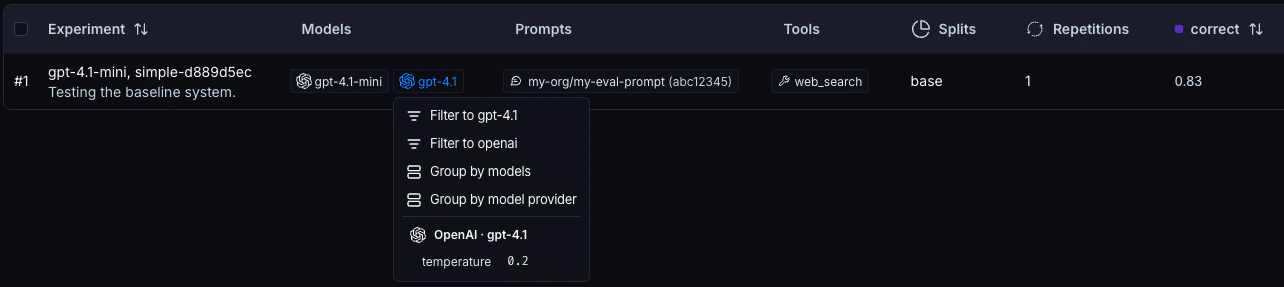

实验表格包含模型、提示词和工具列,显示每个实验使用了哪些模型、提示词和工具,从而更容易一目了然地了解运行之间的变化。 当您从 Playground 运行实验时,这些列会自动填充。通过 SDK 运行实验时,向evaluate() 传递一个包含 models、prompts 和 tools 键的 metadata 对象:

将实验结果下载为 CSV

LangSmith 允许您将实验结果下载为 CSV 文件,以供外部分析和共享。点击实验视图右上角的下载为 CSV 图标。实验结果有 5,000 行的下载限制。

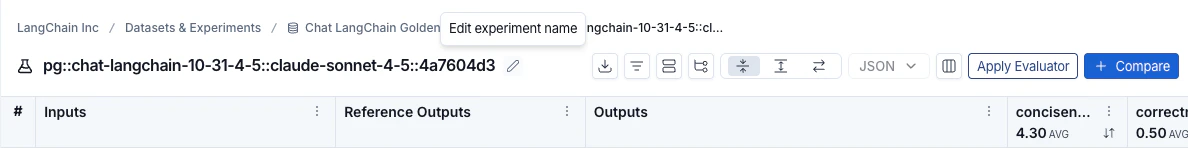

重命名实验

实验名称在每个工作空间内必须是唯一的。

-

实验视图:使用实验名称旁边的铅笔图标重命名实验。

-

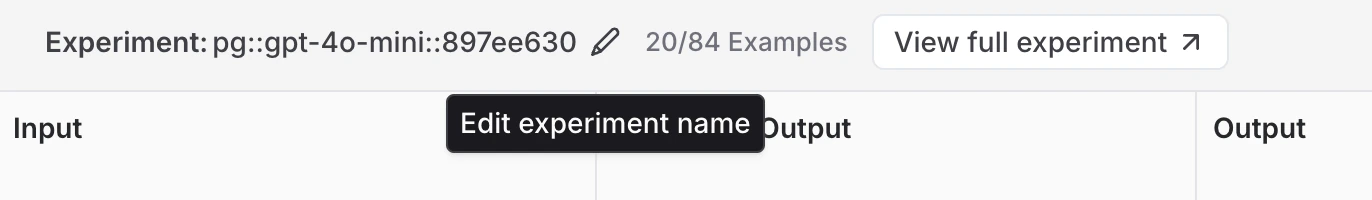

Playground:会自动分配一个格式为

pg::prompt-name::model::uuid的默认名称(例如pg::gpt-4.1-mini::897ee630)。您可以在运行实验后立即通过在 Playground 表格标题中编辑其名称来重命名实验。

Connect these docs to Claude, VSCode, and more via MCP for real-time answers.