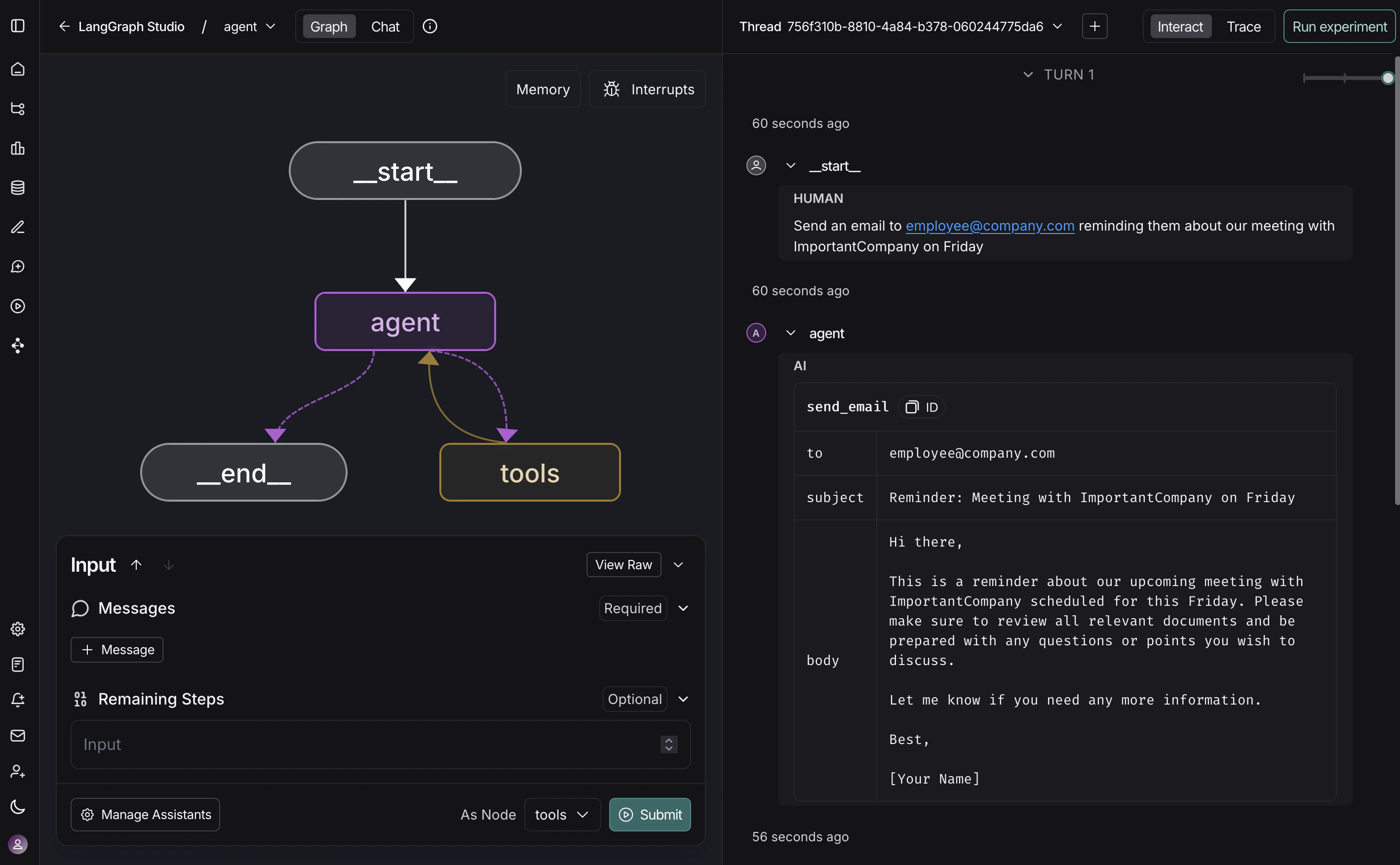

在本地使用 LangChain 构建智能体时,可视化智能体的内部运行过程、实时与其交互并在问题发生时进行调试会非常有帮助。LangSmith Studio 是一个免费的视觉界面,用于从本地机器开发和测试你的 LangChain 智能体。 Studio 会连接到本地运行的智能体,向你展示智能体执行的每个步骤:发送给模型的提示、工具调用及其结果,以及最终输出。你可以测试不同的输入、检查中间状态,并迭代优化智能体的行为,而无需编写额外的代码或进行部署。 本页介绍如何为你的本地 LangChain 智能体设置 Studio。Documentation Index

Fetch the complete documentation index at: https://langchain-zh.cn/llms.txt

Use this file to discover all available pages before exploring further.

前提条件

开始之前,请确保你已满足以下条件:- 一个 LangSmith 账户:在 smith.langchain.com 免费注册或登录。

- 一个 LangSmith API 密钥:请按照创建 API 密钥指南操作。

- 如果你不希望数据被追踪到 LangSmith,请在应用程序的

.env文件中设置LANGSMITH_TRACING=false。禁用追踪后,数据不会离开你的本地服务器。

设置本地智能体服务器

1. 安装 LangGraph CLI

LangGraph CLI 提供了一个本地开发服务器(也称为智能体服务器),用于将你的智能体连接到 Studio。2. 准备你的智能体

如果你已经有一个 LangChain 智能体,可以直接使用它。以下示例使用一个简单的邮件智能体:agent.ts

3. 环境变量

Studio 需要一个 LangSmith API 密钥来连接你的本地智能体。在项目根目录下创建一个.env 文件,并添加从 LangSmith 获取的 API 密钥。

.env

4. 创建 LangGraph 配置文件

LangGraph CLI 使用配置文件来定位你的智能体并管理依赖项。在你的应用目录中创建一个langgraph.json 文件:

langgraph.json

createAgent 函数会自动返回一个已编译的 LangGraph 图,这正是配置文件中 graphs 键所期望的内容。

有关配置文件中 JSON 对象每个键的详细说明,请参阅 LangGraph 配置文件参考。

5. 安装依赖项

6. 在 Studio 中查看你的智能体

启动开发服务器,将你的智能体连接到 Studio:http://127.0.0.1:2024 访问,也可以通过 Studio UI 在 https://smith.langchain.com/studio/?baseUrl=http://127.0.0.1:2024 访问:

视频指南

Connect these docs to Claude, VSCode, and more via MCP for real-time answers.