在线评估为您的生产轨迹提供实时反馈。这对于持续监控应用程序性能非常有用——可以识别问题、衡量改进效果,并确保长期保持一致的品质。 代码评估器允许您直接在 LangSmith 中使用 Python 或 JavaScript 编写评估器。通常用于验证数据的结构或统计属性。Documentation Index

Fetch the complete documentation index at: https://langchain-zh.cn/llms.txt

Use this file to discover all available pages before exploring further.

当在线评估器在轨迹中的任何运行上执行时,该轨迹将自动升级为扩展数据保留。此升级会影响轨迹定价,但确保符合您评估标准(通常是那些对分析最有价值的轨迹)的轨迹得以保留以供调查。

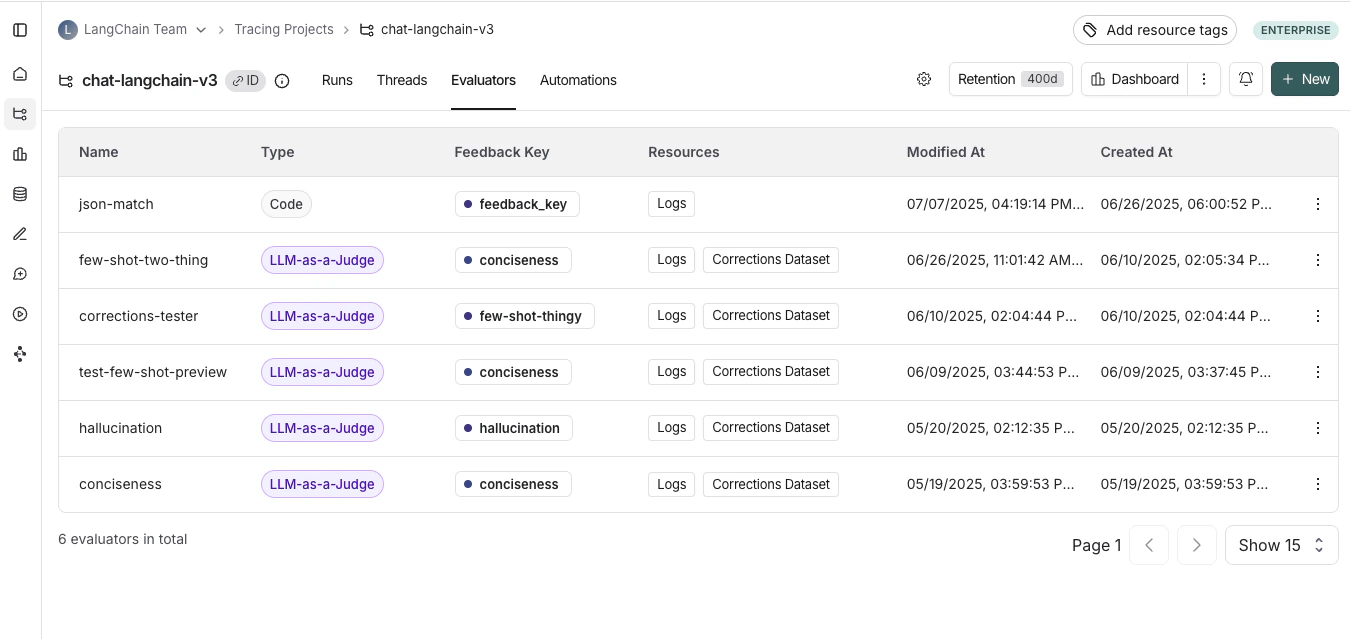

查看在线评估器

前往 Tracing Projects 标签页并选择一个追踪项目。要查看该项目的现有在线评估器,请点击 Evaluators 标签页。

配置在线评估器

1. 导航至在线评估器

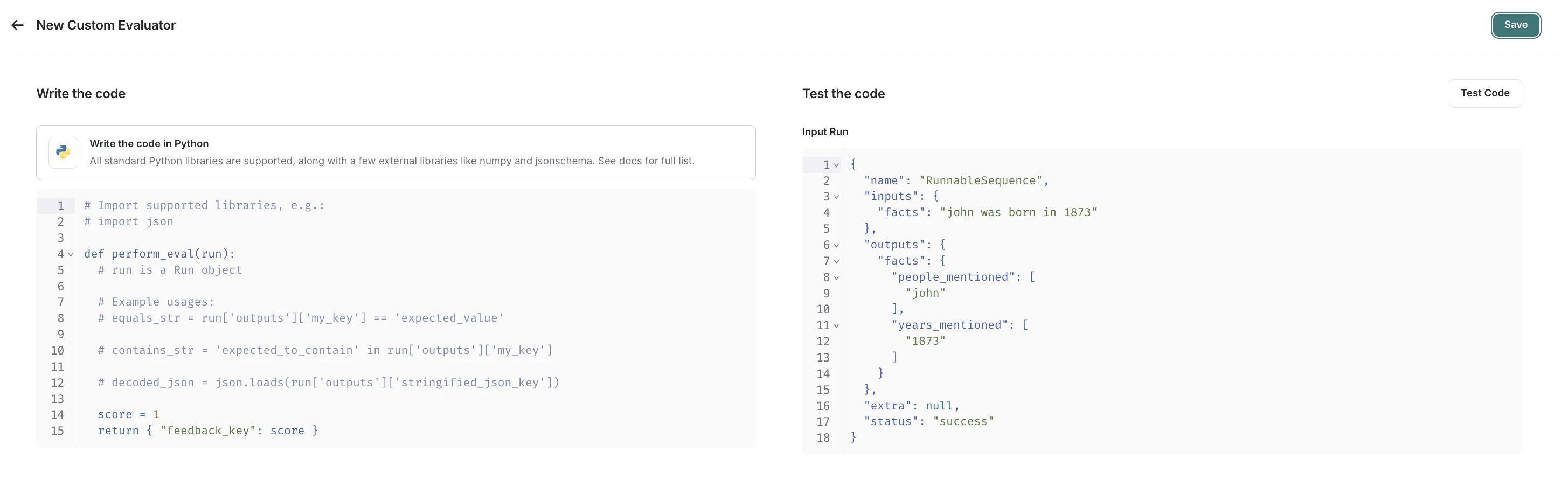

前往 Tracing Projects 标签页并选择一个追踪项目。点击追踪项目页面右上角的 + New,然后点击 New Evaluator。选择 code 评估器。2. 命名您的评估器

3. 创建过滤器

例如,您可能希望基于以下条件应用特定的评估器:- 运行中用户留下反馈表明响应不令人满意。

- 运行中调用了特定的工具调用。有关更多信息,请参阅筛选工具调用。

- 运行匹配特定的元数据片段(例如,如果您记录带有

plan_type的轨迹,并且只想对来自企业客户的轨迹运行评估)。有关更多信息,请参阅向轨迹添加元数据。

4. (可选)配置采样率

配置采样率以控制触发自动化操作的过滤运行百分比。例如,为了控制成本,您可能希望设置过滤器,仅将评估器应用于 10% 的轨迹。为此,您需要将采样率设置为 0.1。5. (可选)将规则应用于过去的运行

通过切换 Apply to past runs 并输入“Backfill from”日期,将规则应用于过去的运行。这仅在规则创建时可能。注意:回填作为后台作业处理,因此您不会立即看到结果。 为了跟踪回填进度,您可以查看评估器的日志,方法是前往追踪项目内的 Evaluators 标签页,并点击您创建的评估器的 Logs 按钮。在线评估器日志类似于自动化规则日志。- 添加评估器名称

- 可选地筛选您希望应用评估器的运行,或配置采样率。

- 选择 Apply Evaluator

编写您的评估函数

代码评估器限制。允许的库:您可以导入所有标准库函数,以及以下公共包:网络访问:您无法从代码评估器访问互联网。

- 一个

Run(参考)。这代表要评估的采样运行。

- 反馈字典:一个字典,其键是您想要返回的反馈类型,值是为该反馈键给出的分数。例如,

{"correctness": 1, "silliness": 0}将在运行上创建两种类型的反馈,一种表示正确,另一种表示不愚蠢。

测试并保存您的评估函数

在保存之前,您可以通过点击 Test Code 在最近的运行上测试您的评估器函数,以确保代码正确执行。 一旦您点击 Save,您的在线评估器将在新采样的运行(或如果您选择了回填选项,也包括回填的运行)上运行。 如果您更喜欢视频教程,请查看 LangSmith 入门课程中的在线评估视频。Connect these docs to Claude, VSCode, and more via MCP for real-time answers.