Playground 允许你使用任何符合 OpenAI API 规范的模型。你可以通过在 Playground 中设置代理提供商来使用你的模型。Documentation Index

Fetch the complete documentation index at: https://langchain-zh.cn/llms.txt

Use this file to discover all available pages before exploring further.

部署兼容 OpenAI 的模型

许多提供商提供兼容 OpenAI 的模型或代理服务。一些例子包括: 你可以使用这些提供商来部署你的模型,并获得一个符合 OpenAI API 规范的 API 端点。 查看完整的规范以获取更多信息。在 Playground 中使用模型

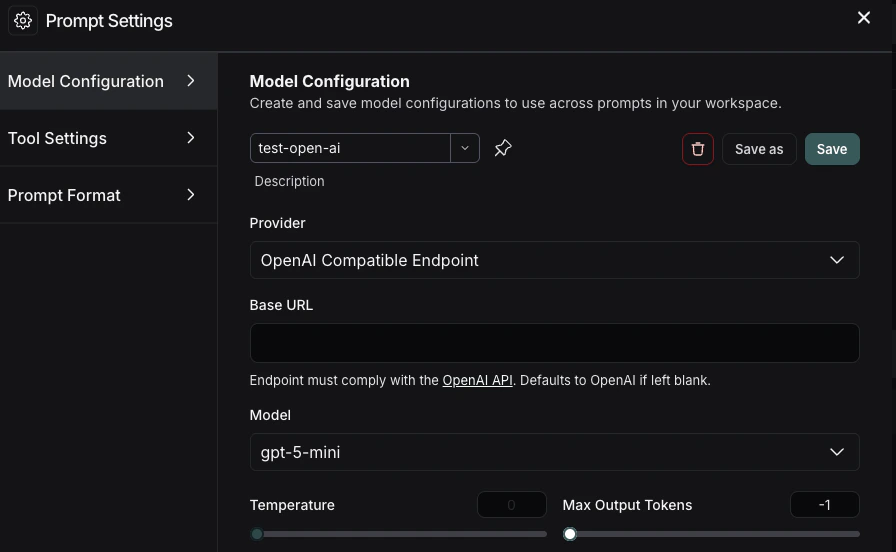

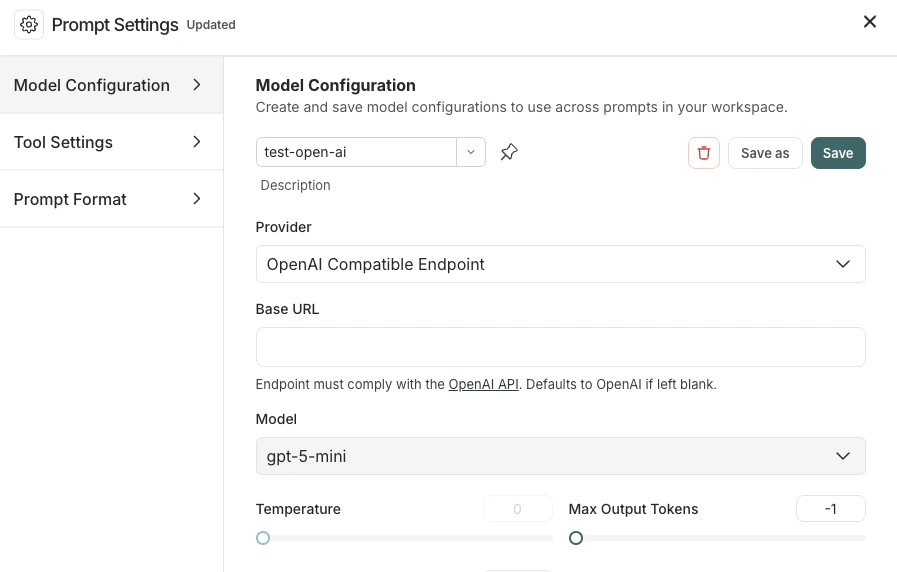

一旦你部署了模型服务器,就可以在 Playground 中使用它。 要访问 提示设置 菜单:- 在 Prompts 标题下,选择模型名称旁边的齿轮 图标。

- 在 模型配置 标签页中,从下拉菜单中选择要编辑的模型。

- 在 提供商 下拉菜单中,选择 OpenAI 兼容端点。

-

将你的 OpenAI 兼容端点添加到 基础 URL 输入框中。示例请参见基础 URL 格式。

基础 URL 格式

基础 URL 应指向你的 OpenAI 兼容 API 服务器的根目录。 LangSmith 会自动附加/chat/completions——请勿将其包含在基础 URL 中。

基础 URL 示例

| 提供商 | 示例基础 URL |

|---|---|

| Ollama (本地) | http://localhost:11434/v1 |

| LiteLLM 代理 (本地) | http://localhost:4000 |

| vLLM (本地) | http://localhost:8000/v1 |

| 自托管 (远程) | https://my-model-server.example.com/v1 |

/api/v2/chat/completions 路径下提供补全服务,

请将基础 URL 设置为 https://my-server.example.com/api/v2。

Connect these docs to Claude, VSCode, and more via MCP for real-time answers.